Harness 已过时,Environment Engineering 是未来

hi,我是渔夫。

最近,只要关注 AI 工程领域的都知道,有个词 Harness Engineering 火爆了。

它是什么?解决什么痛点?

我研读了 OpenAI、Anthropic 官方博客后得出的结论(文末有链接),他们都指向同一个问题:AI Agent 在执行长任务时,会悄悄崩掉,会慢慢跑偏。

Anthropic 的工程师发现,哪怕给 Agent 配了 context 压缩机制,它还是会在某个节点突然”认为项目完成了”,或者重复造轮子,或者把之前做对的东西改错,自己评价太过于自信。

OpenAI 的团队用 Codex 跑了五个月零人工写代码的实验,得出的结论是:工程师的工作重心,已经从写代码转移到设计环境、构建反馈回路、搭建脚手架。

大家遇到的问题,并非是模型能力不够,而是环境定义不清——Agent 缺少所需的工具、抽象层和内部结构来推进高层目标,这是环境欠规格问题。

Harness 要解决的问题:在模型外部搭一个执行框架,管状态、管边界、管重试、管跨 Session 的记忆传递、Hooks 等,让 Agent 不只是能跑,而是跑完了还对。

Harness 其实在 2025 年底在硅谷就已经受到高度关注了。

我本人也一直在密切关注 AI Agent 工程化领域,但会遇到一些问题——很多开源项目庞大复杂。于是,决定自己设计一个 Harness 项目,已经完整端到端测试了。

GitHub 地址:harness-cowork

harness-cowork 简介

AI Agent 写代码容易,持续可靠地写代码难。harness-cowork 就是为了解决该问题的。下面我简单介绍架构哲学,也是复现 OpenAI、Anthropic 及社区讨论的观点,是一个极简、轻量的尝试。

三层对抗架构

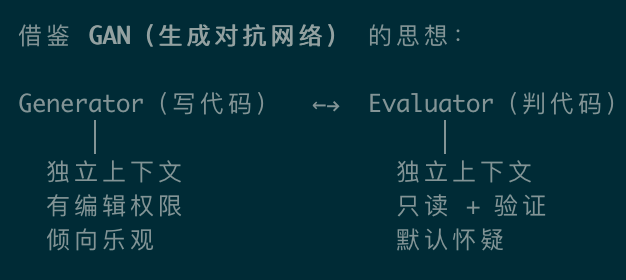

第一层:Generator vs Evaluator(对抗式分离)

借鉴 GAN(生成对抗网络)的思想:

关键设计:

- Evaluator 运行在独立的 Claude 会话中——没有沉没成本压力

- 默认立场是”大概率有问题,除非证明没问题”

- 6 个维度打分,任何一项 FAIL = 整体 FAIL

- FAIL 后反馈回 Generator 重试,形成对抗式闭环

第二层:概率层 + 确定层(双保险)

Prompt/Skill 是概率性的——你说”提交前跑 lint”,Agent 90% 会听,10% 会漂移。那 10% 就是 bug 的来源。

概率层(Skill/Prompt)“应该做什么”,90% 有效。这层主要是 SKILL.md 定义工作流(intake → triage → investigate → plan → execute → evaluate)。

确定层(Hook/规则引擎)“不能不做什么”,确保 100% 有效。使用 Hook 脚本 + config.json 声明式规则,机械拦截危险操作。

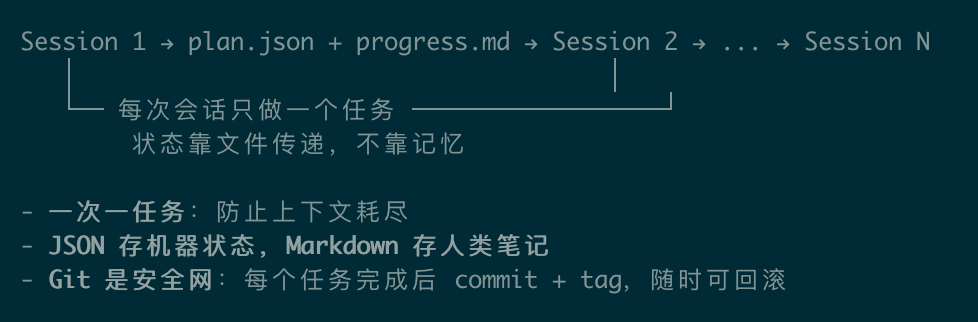

第三层:上下文隔离 + 状态外置

解决 Agent 的”上下文焦虑”——窗口快满时就提前收工的问题。

如何使用

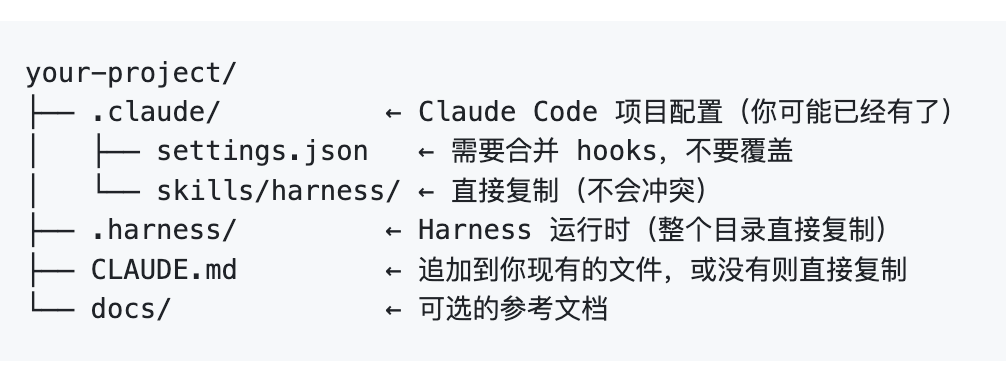

架构设计讲完了,harness-cowork 如何使用呢?注意它不是一个软件包,只是一组你放入项目的文件。

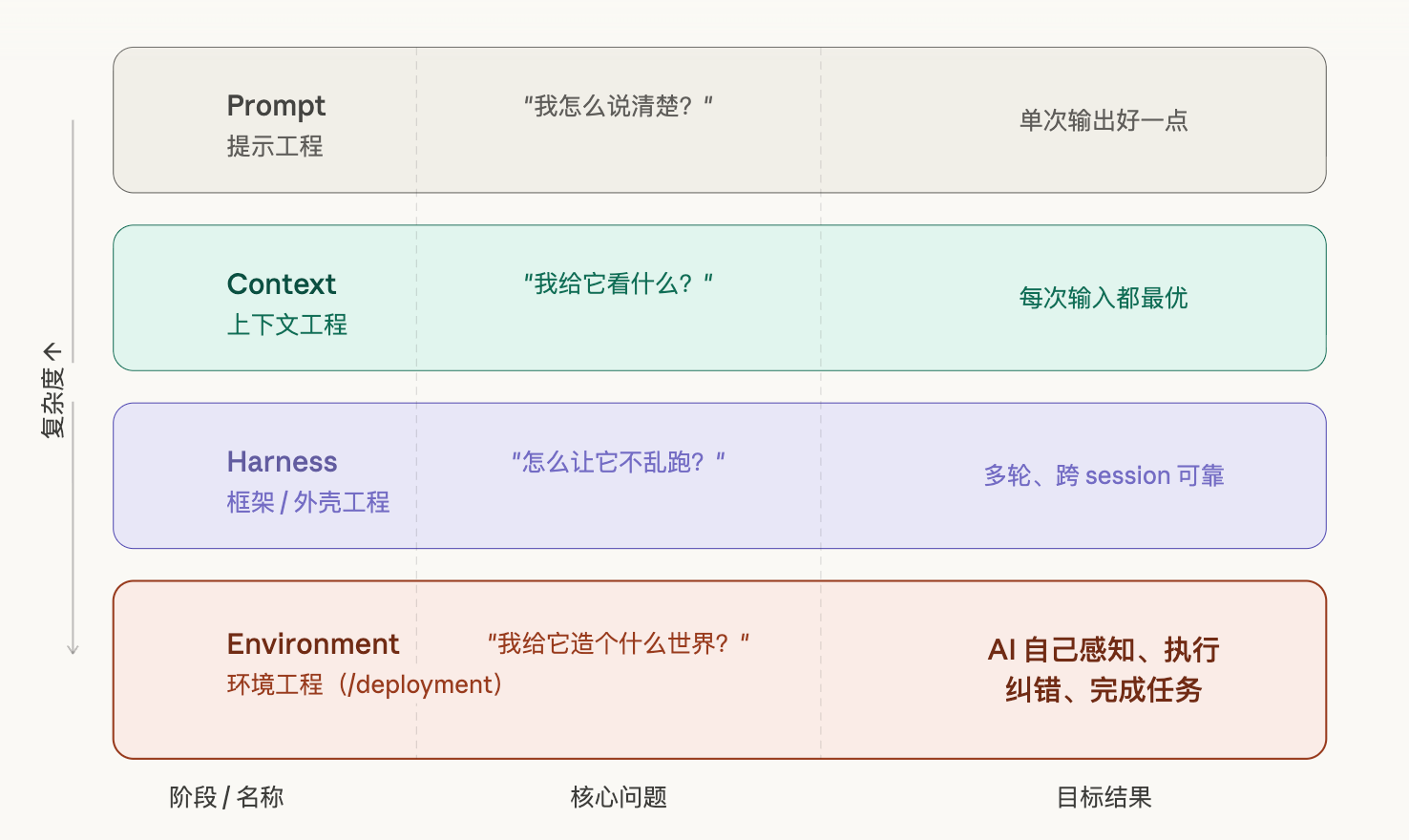

从这个项目可以学到很多东西。如果你也和我一样正在学习 Claude Code,真建议完成这样一个实验,会让你熟悉整个框架,也更好理解从 Prompt、Context 到 Harness 都为你做了什么。

项目还处于早期,非常轻量级,没有那么复杂,日常中遇到需要时再慢慢新增吧。

如果有人感兴趣,欢迎去使用,甚至二次改造。

Harness 已死,Environment 才是未来

学完了 Harness,如果你密切关注 OpenAI 和 Anthropic 的新动态,其实这种”框架”早已经过时了。

为什么?因为 Claude 这类基础模型正在把开发者以前手写的编排逻辑直接内化进去。后面,你那些简单的包装器和执行循环的价值就基本归零了。

他们的结论很直接:停止构建复杂的中间件。把精力放到环境工程上,把软件和数据整理成 Agent 能看懂、能用好的结构,比如 MCP 这类标准。

Anthropic 的实验也证明了,环境定义清楚,Agent 表现会好很多。

为什么”Harness 已死”有它的道理

说实话,这个论点并非空穴来风,趋势很明显。

一年前要写几百行代码才能搞定的重试逻辑、JSON 校验、上下文管理,现在 GPT-5 一个 API 参数就解决了。那些核心价值只是”把 Prompt 串起来”的框架,护城河基本没了。

另一边,环境工程的价值确实在放大。Anthropic 的研究发现,Agent 失败大多不是模型太笨,而是环境太乱。就像 F1 赛车开进沼泽地,不是车的问题。但给它一条干净的赛道、清晰的 API 文档,它能跑出完全不同的结果。

结论看起来很清晰:别再造更复杂的卡车了,去修路。

回头看 AI Agent 工程的演进,从 2023 年的 Prompt 加速发展到 Context,再到 2025 年末的 Harness Engineering。

但如今,Environment Engineering 正在硅谷的工程话语中占据主导地位。

以上,是今天的分享。

感谢你看我的文章,如果内容对你有启发,随手转发三连吧!